- René Munnik

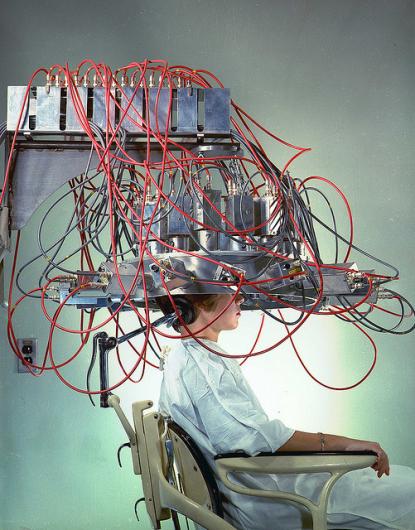

We raken er inmiddels aan gewend dat ons bestaan door en door verwikkeld is met elektronische apparaten waarmee we onze wereld transformeren tot een intelligente en interactieve omgeving. Maar de techniek koloniseert niet alleen onze leefwereld, ze gaat ook onderhuids en kruipt tussen de oren. De koppeling van informatica met biotechnologie, cognitiewetenschappen en nanotechnologie (NBIC) maakt een ongekende miniaturisering mogelijk van apparatuur die gemakkelijk in het lichaam is onder te brengen. Zo worden (brein)implantaten ontwikkeld als Deep Brain Stimulation (DBS) die bepaalde hersengebieden prikkelen ter bestrijding van symptomen van de ziekte van Parkinson. Andere toepassingen zijn nog in ontwikkeling, zoals brein-machine interfaces waarmee een invalide zijn rolstoel niet meer bestuurt met zijn lichaam maar, na oefening, via sensoren onmiddellijk vanuit de hersenen, enkel door te ‘willen’ – dus veeleer als zijn lichaam.

Deze ontwikkelingen hebben tot gevolg dat de grens tussen mens en machine gaandeweg vervaagt. Tot voor kort lagen de zaken duidelijk: men kon volstaan met het wezensonderscheid tussen de levende, redelijke, autonome mens, en de levenloze, redeloze, heteronome machine. En als men het wat minder filosofisch formuleerde, dan kon men de techniek (op een heupgewricht of hartklep na) toch hoofdzakelijk plaatsen ‘buiten’ opperhuid en hersenpan, terwijl men zelf woonde in het innerlijk, ‘ergens onder’ huid en schedeldak. Of als een simpele rolverdeling: de mens als ontwerper of gebruiker en de techniek als ontwerp of gebruiksmiddel. Maar zo helder liggen die scheidslijnen niet meer. DBS kan als ongewenst neveneffect persoonlijkheidsveranderingen bij de patiënt teweegbrengen. Maar waar moet een rechter de grens trekken tussen menselijke aansprakelijkheid en technisch falen, wanneer zo’n patiënt onder invloed daarvan een misdaad begaat? Zo’n probleem los je niet op door halsstarrig in termen van menselijke subjecten en technische objecten te blijven denken.

Het lijkt me duidelijk dat deze toenemende verwevenheid van mens en techniek tot mens-machine-systemen (hybriden, cyborgs), ons dwingt om een aantal vragen opnieuw te doordenken. Vragen met betrekking tot de filosofische antropologie en de ethiek bijvoorbeeld. Want hoe moeten we over menselijk handelen en menselijke verantwoordelijkheid denken, wanneer handelings- en beslissingsketens in feite over mens en techniek zijn gedistribueerd?

Revolutionaire technische ontwikkelingen als deze kennen in het algemeen een drietal onzekerheden. De eerste is de feitelijke onzekerheid: de onmogelijkheid om zekere voorspellingen te doen met betrekking tot de toekomstige maatschappelijke inbedding en de culturele spin-off van nieuwe technologieën. Ondanks alle doorwrochte toekomstscenario’s kan men van een technologie die nog in een ontwikkelingsfase verkeert wellicht wel een aantal beloften, dilemma’s en risico’s in kaart brengen, maar wat haar maatschappelijke betekenis en toekomstige (neven)effecten zullen zijn valt eigenlijk niet te voorspellen. Nieuwe technologieën lijken in dat opzicht op geneesmiddelen zonder bijsluiters. Die feitelijke onzekerheid over de gevolgen maakt beleidsmatige en politieke sturing van technologieontwikkeling moeilijk.

De tweede is de normatieve onzekerheid. Deze betreft niet de kennis van technologische ontwikkelingen, maar het toekomstig normatief kader waarmee die beoordeeld worden. Morele criteria veranderen vaak onder invloed van de maatschappelijke inbedding van nieuwe technologie. Denk bijvoorbeeld aan de rol die de introductie van de anticonceptiepil speelde in veranderingen in de seksuele moraal en in de algemeen aanvaarde ideeën over de verhouding van mannen en vrouwen. De normatieve onzekerheid is dus niet de onzekerheid over de feitelijke gevolgen van nieuwe technologie, maar de onzekerheid over de mogelijkheid om vanuit ons huidige morele kader de criteria te voorzien waarmee men in de toekomst die gevolgen zal beoordelen.

De derde is de onzekerheid aangaande de symbolische orde. Zowel onze kennis van de feiten als onze morele beoordeling daarvan veronderstelt dat wij de werkelijkheid ordenen met behulp van cultureel bepaalde classificatieschema’s. Daarbij koersen we op een aantal fundamentele onderscheidingen of ‘grenzen’ die we normaliter niet ter discussie stellen: levend/levenloos, mens/dier/ding, geest/lichaam, binnen/buiten, natuur/cultuur, normaal/abnormaal, enzovoorts. Men noemt deze classificatieschema’s de symbolische orde. De onzekerheid aangaande de symbolische orde komt erop neer dat hedendaagse technologie onze gangbare culturele classificatieschema’s aanvreet, door de fundamentele grenzen die daarin vervat zijn te overschrijden, te verwarren of te laten vervagen. De hierboven genoemde mens-machinesystemen of cyborgs zijn daarvan een voorbeeld want ze zijn de belichaamde verwarring van mens en machine, van natuur en techniek, van het levende en het levenloze. In cultureel-antropologisch idioom zijn het ‘monsters’: hedendaagse representanten van de chimaeren of hybride wezens uit de mythologie, zoals de Minotauros en de Sfinx. Deze wezens roepen vaak verontrusting en weerzin op, zonder dat die verontrusting kan worden uitgedrukt binnen het taalspel van de aan redelijkheid gebonden ethische argumentatie, laat staan in termen van beleidsstudies, risicoanalyses of kosten-batenafwegingen. In feite gaat het hier eerder om een levensbeschouwelijke dan om een epistemische of ethische problematiek, want uiteindelijk staan hier de grondslagen van onze kijk op de werkelijkheid – levens-beschouwing dus – op het spel. En hoe meer we de techniek in ons lijf en ons leven toelaten, hoe minder de theologie daar omheen kan.

Foto: Pre PET-headgear door Brookhaven National Laboratory (CC BY-NC-ND 2.0)